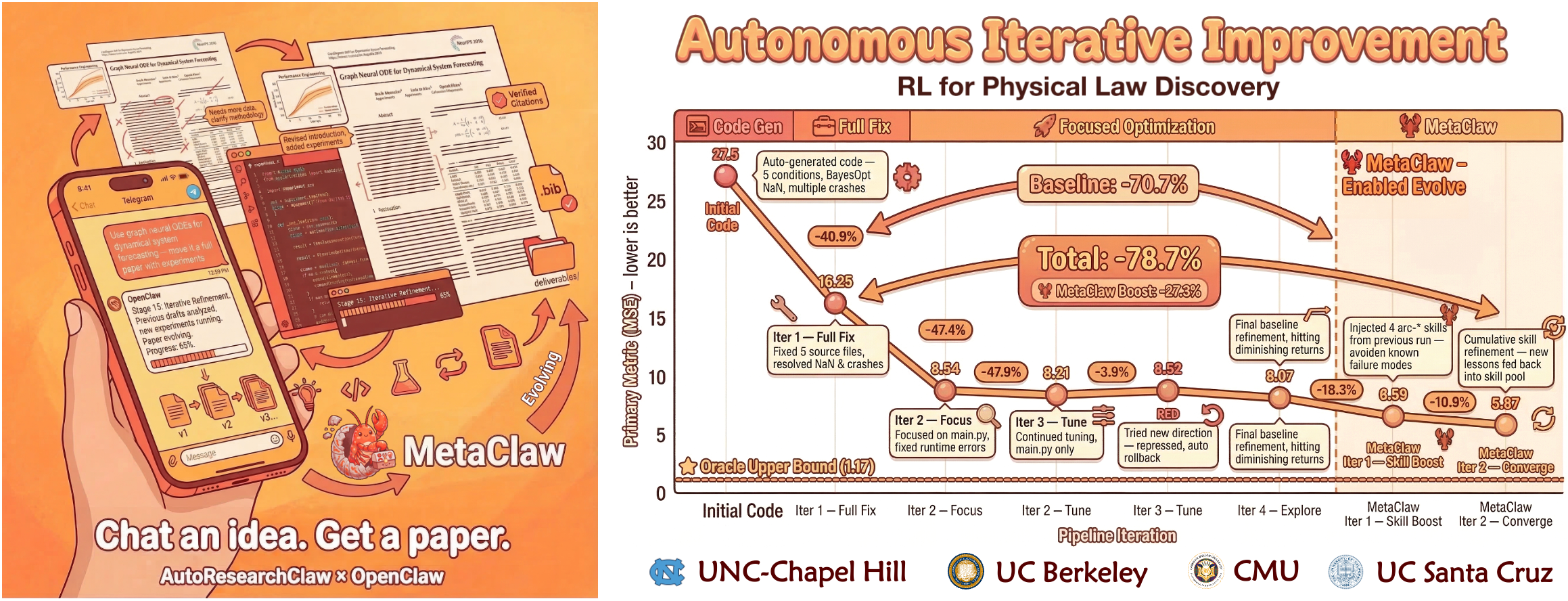

OpenClaw에 채팅하세요: "X 연구해줘" → 완료.

🇺🇸 English · 🇨🇳 中文 · 🇯🇵 日本語 · 🇰🇷 한국어 · 🇫🇷 Français · 🇩🇪 Deutsch · 🇪🇸 Español · 🇧🇷 Português · 🇷🇺 Русский · 🇸🇦 العربية

🏆 논문 쇼케이스 · 📖 통합 가이드 · 💬 Discord 커뮤니티

---

|

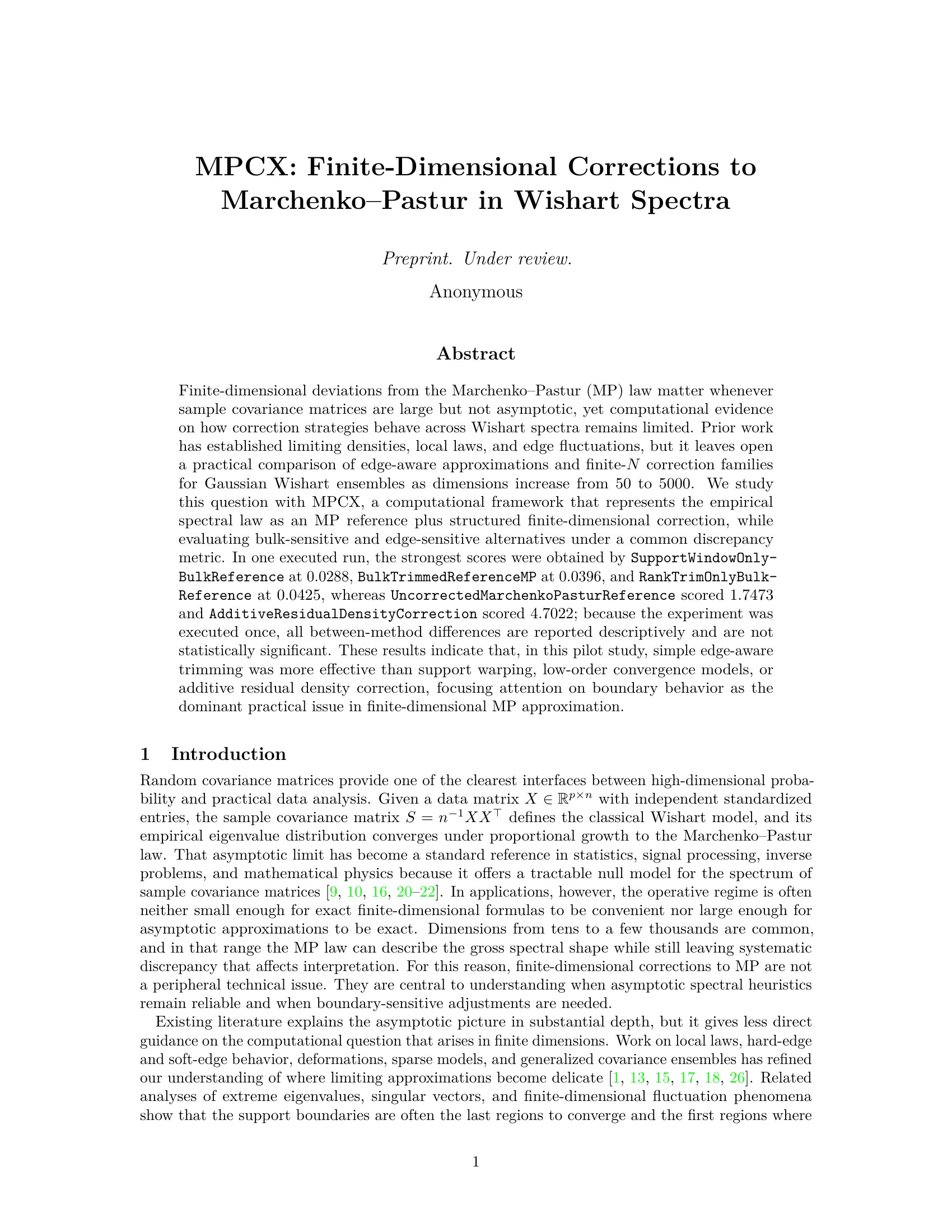

🏆 생성된 논문 쇼케이스 8개 분야에 걸친 8편의 논문 — 수학, 통계, 생물학, 컴퓨팅, NLP, RL, 비전, 견고성 — 인간 개입 없이 완전 자율 생성.

|

| 📄 | paper_draft.md | 완성된 학술 논문 (서론, 관련 연구, 방법론, 실험, 결과, 결론) |

| 📐 | paper.tex | 학회 제출용 LaTeX (NeurIPS / ICLR / ICML 템플릿) |

| 📚 | references.bib | OpenAlex, Semantic Scholar, arXiv에서 가져온 실제 BibTeX 참고문헌 — 인라인 인용과 일치하도록 자동 정리 |

| 🔍 | verification_report.json | 4계층 인용 무결성 + 관련성 검증 (arXiv, CrossRef, DataCite, LLM) |

| 🧪 | experiment runs/ | 생성된 코드 + 샌드박스 결과 + 구조화된 JSON 메트릭 |

| 📊 | charts/ | 오차 막대와 신뢰 구간이 포함된 자동 생성 조건 비교 차트 |

| 📝 | reviews.md | 방법론-증거 일관성 검사를 포함한 멀티 에이전트 피어 리뷰 |

| 🧬 | evolution/ | 각 실행에서 추출된 자기 학습 교훈 |

| 📦 | deliverables/ | 모든 최종 산출물을 하나의 폴더에 — Overleaf에 바로 컴파일 가능 |

Built with 🦞 by the AutoResearchClaw team